Rechtliche Rahmenbedingungen und Unterstützung durch die KI-Servicestelle RTR

Gastbeitrag der KI-Servicestelle RTR

Lesedauer: 7 Minuten

Der europäische AI Act enthält als Produktsicherheitsgesetz Sicherheitsvorschriften insbesondere in besonders heiklen Bereichen. Manche Praktiken werden in Europa verboten.

Der AI Act und sein Inkrafttreten

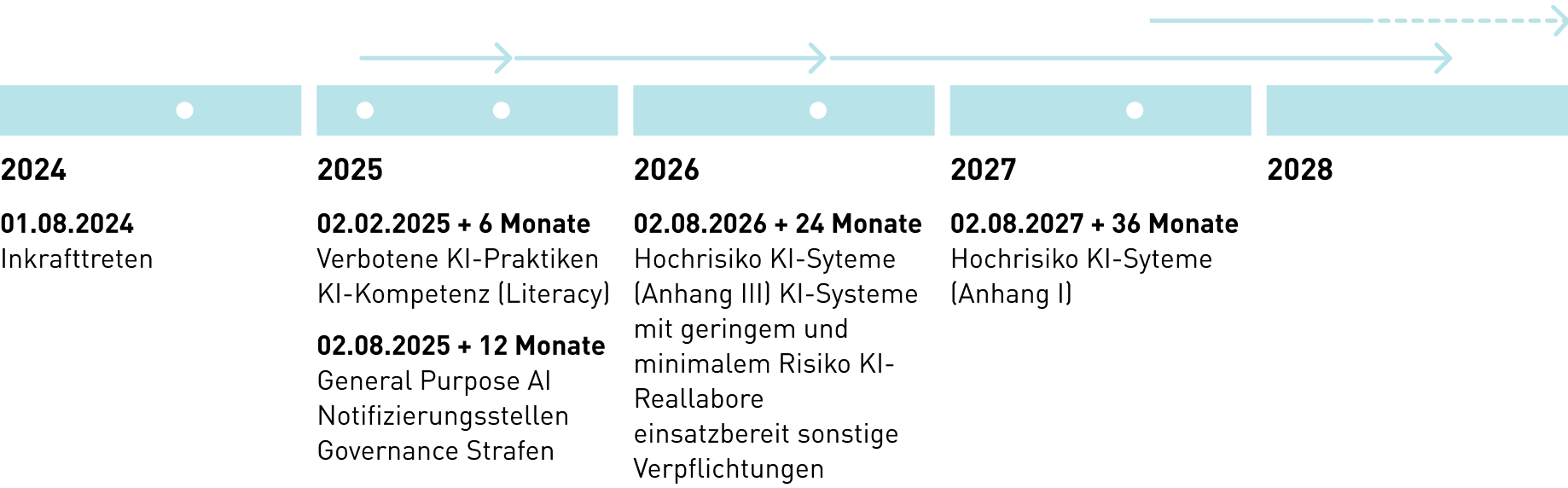

Der am 1.8.2024 in Kraft getretene AI Act sieht einen abgestuften Rahmen für den zeitlichen Geltungsbereich der Bestimmungen vor. Die folgende Abbildung stellt einen Überblick über die wichtigsten Bestimmungen, die erst nach und nach Gültigkeit erlangen, dar. Die Übergangsfristen ermöglichen es, zeitgerecht die betroffenen Produkte anzupassen.

Mit 2.2.2025 sind die Bestimmungen zu verbotenen KI-Praktiken sowie zur KI-Kompetenz in Kraft getreten. Mit 2.8.2025 erfolgte insbesondere das Inkrafttreten der Bestimmungen zu KI-Modellen mit allgemeinem Verwendungszweck und den Sanktionen. Die ersten Verpflichtungen zu Hochrisiko-KI-Systemen werden am 2.8.2026 in Kraft treten.

Die Rollen im AI Act

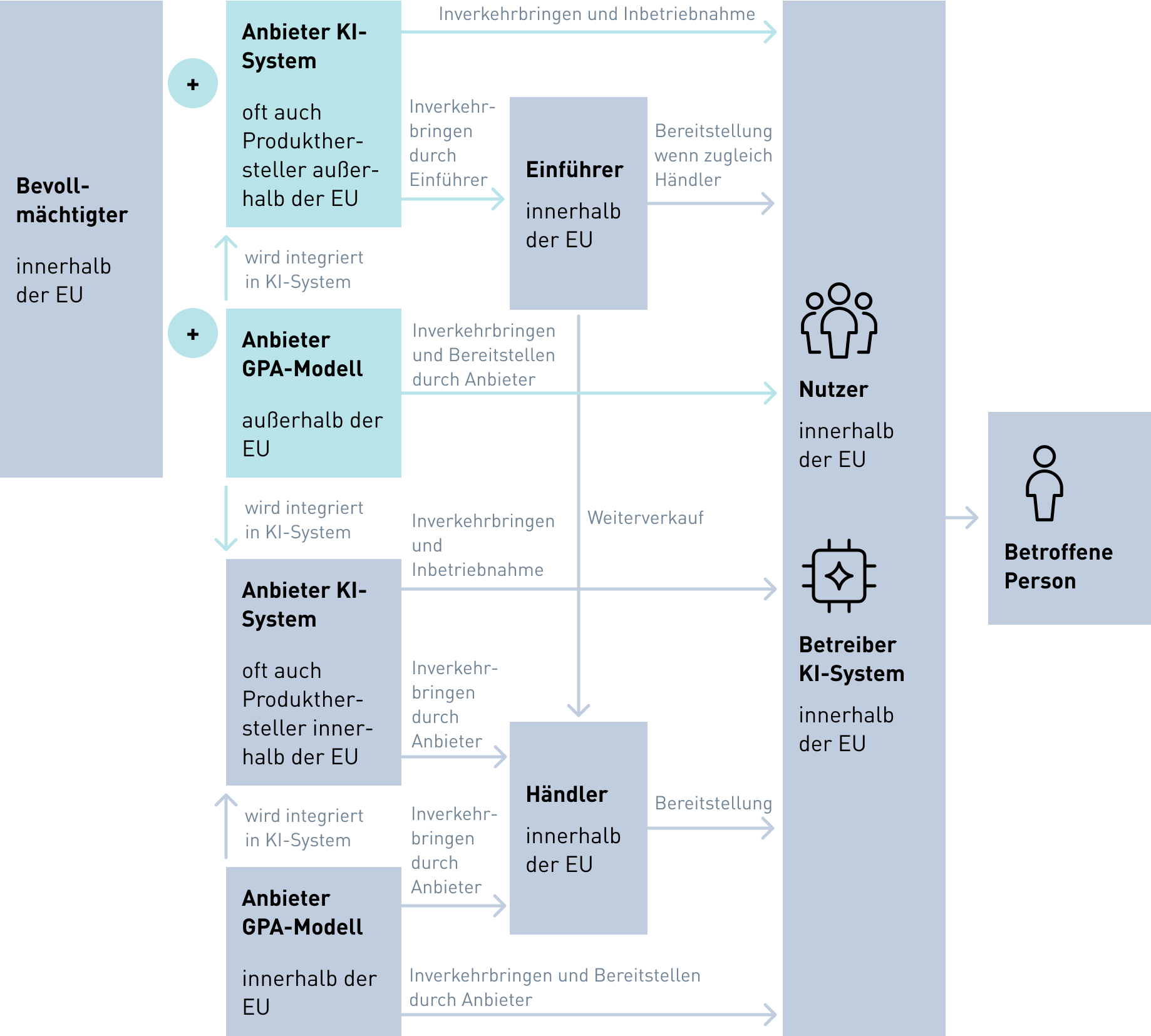

Der AI Act sieht viele Rollen in der KI-Wertschöpfungskette vor, die darin verschiedene Tätigkeiten übernehmen. Unterschieden wird dabei zwischen „Inverkehrbringen“, „Bereitstellen“ und „Inbetriebnahme“. Zu den Akteuren im AI Act zählen etwa „Anbieter“, „Produkthersteller“, „Betreiber“, und „Händler“.

Wenn KMUs am Markt befindliche KI-Systeme in eigener Verantwortung für die Erfüllung diverser Aufgaben verwenden, sind sie meist als „Betreiber“ gemäß Art 3 Z 4 AIA einzustufen. In der KI-Wertschöpfungskette sind sie den Anbietern nachgelagert – sie entwickeln KI-Systeme nicht, führen diese aber in der unternehmerischen Praxis aus. Eine Ausnahme besteht nur, falls KI-Systeme entgegen ihrer Zulassung eingesetzt werden – in diesem Fall zählen auch die einsetzenden Unternehmen als „Anbieter“ (vgl. Art 25 AIA).

Eine risikobasierte Regulierung

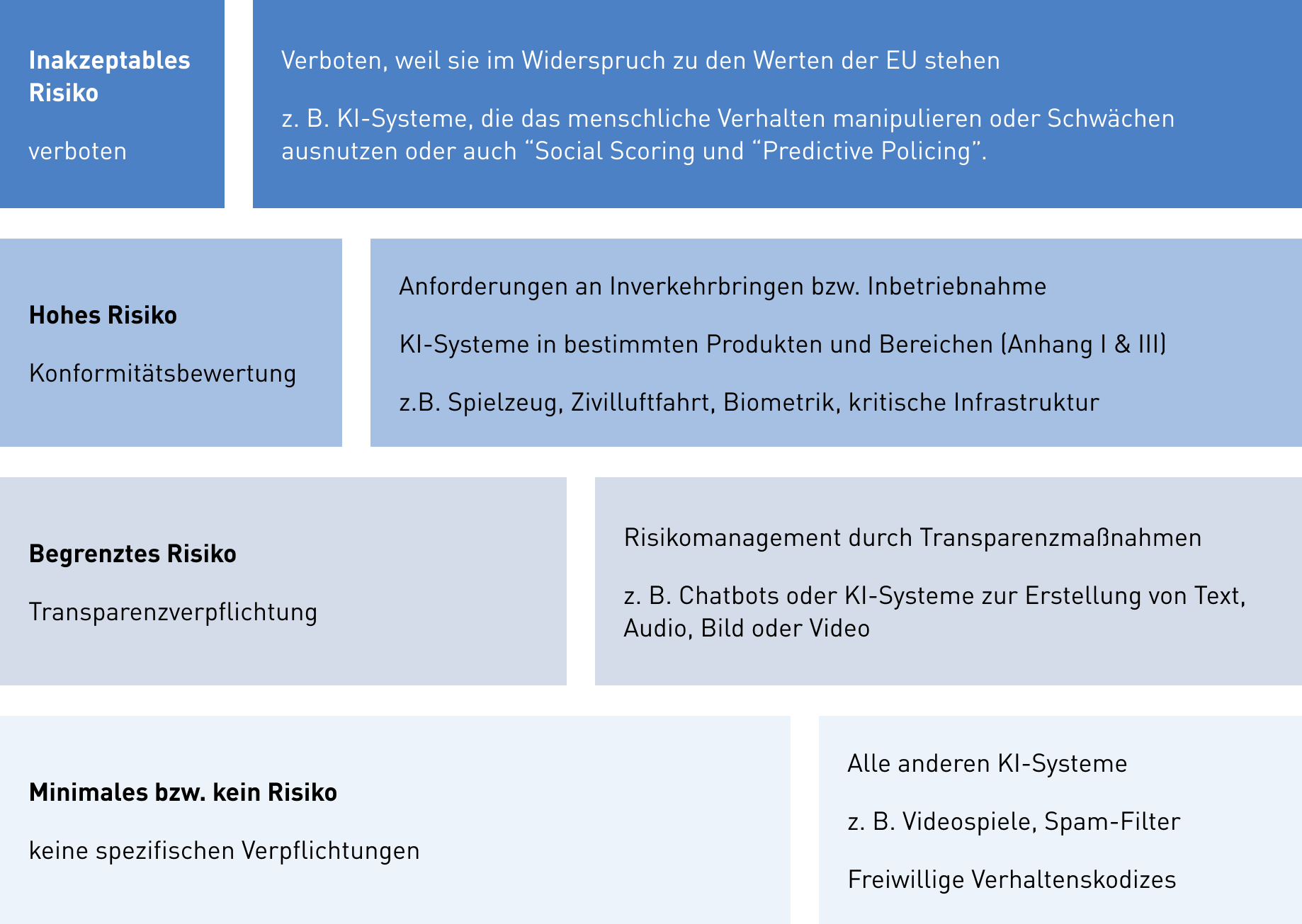

Der AI Act verfolgt einen risikobasierten Ansatz, um ein verhältnismäßiges, wirksames und verbindliches Regelwerk für KI-Systeme einzuführen. KI-Systeme werden entsprechend ihrem Risikopotential nach inakzeptablem, hohem, begrenztem und minimalem Risiko kategorisiert. Die folgende Grafik dient zur besseren Veranschaulichung der Risikostufen für KI-Systeme.

Verbotene KI und Hochrisiko-KI

Manche Praktiken in Zusammenhang mit KI-Systemen bergen ein zu hohes Risiko im Hinblick auf die Wahrscheinlichkeit eines Schadenseintritts und auch des Schadensausmaßes an individuellen oder öffentlichen Interessen, weshalb sie verboten sind – etwa KI-Systeme für Social Scoring oder Predictive Policing.

Um diese Verbote in der Praxis besser einordnen zu können, hat die Kommission Leitlinien veröffentlicht, die als unverbindliche Auslegungshilfe dienen. Sie enthalten rechtliche Erläuterungen und praktische Beispiele, um den AI Act zu verstehen und einzuhalten. Die Leitlinien stehen auch in deutscher Sprache zur Verfügung. Den Link zu den Leitlinien finden Sie auf der Webseite der KI-Servicestelle unter der Rubrik „Ergänzende Leitlinien und Dokumente“.

Hochrisiko-KI-Systeme stellen – wie bereits der Name sagt – im Hinblick auf die Wahrscheinlichkeit eines Schadenseintritts und auch des Schadensausmaßes an individuellen oder öffentlichen Interessen ein hohes Risiko dar, sind aber gemäß Art 6 AIA nicht per se verboten. Das Inverkehrbringen oder die Inbetriebnahme ist unter Einhaltung bestimmter Anforderungen erlaubt. Derartige KI-Systeme sind unter anderem im Anhang I und III des AI Act aufgelistet (z.B. KI-Systeme im Bereich des Mitarbeiterrecruitings sind als Hochrisiko-KI-Systeme gemäß Anhang III Z 4 lit a AIA einzustufen). Für Betreiber sind die Verpflichtungen in Zusammenhang mit dem Betrieb von Hochrisiko-KI-Systemen in Artikel 26 AIA aufgelistet.

Auf europäischer Ebene gibt es bereits Leitlinien zur Interpretation des „KI-Systems“. Zur Auslegung der Hochrisiko-KI-Bereiche werden Leitlinien für das Jahr 2026 erwartet.

GPAI-Modelle

Sogenannte General Purpose AI Models (KI-Modelle mit allgemeinem Verwendungszweck) sind KI-Modelle, die ein breites Spektrum von Aufgaben bewältigen können, anstatt für eine spezifische Aufgabe oder Anwendung optimiert worden zu sein. Diese Modelle sind oft in der Lage, große Mengen an unstrukturierten Daten wie Text, Bildern, Audio und Videos zu verarbeiten. Beispiele für solche GPAI-Modelle sind die großen Sprachmodelle von OpenAI und anderen Anbietern.

Um die Umsetzung des AI Acts zu gewährleisten und die Verständlichkeit zu verbessern, haben das AI-Office und die Europäische Kommission Begleitmaterialien veröffentlicht.

Ein vom AI-Office am 10.7.2025 veröffentlichter Praxisleitfaden - sogenannter „Code of Practice“ (CoP) - besteht aus drei Dokumenten und enthält Informationen zu Transparenzmaßnahmen und zur Ermittlung und Analyse systemischer Risiken sowie Regelungen zur Beachtung des Urheberrechts.

Die von der Europäischen Kommission am 18.07.2025 veröffentlichten Leitlinien für Anbieter von KI - Modellen mit allgemeinem Verwendungszweck enthalten technische Kriterien, die die Kategorisierung von KI-Modellen erleichtern sollen und präzisieren die Ausnahme für Open-Source klar. Zudem wurde darin festgestellt, dass nur wesentliche Änderungen unter Aufwendung massiver Rechenkapazität dazu führt, dass es zu einem Angebot neuer KI-Modelle führt. Es lässt sich deshalb aus den Leitlinien ableiten, dass österreichische Unternehmen nur im absoluten Ausnahmefall eine Rolle als Anbieter einnehmen werden.

Die Links zum Praxisleitfaden und den Leitlinien können der Webseite der KI-Servicestelle entnommen werden.

Transparenzpflichten bei KI-Inhalten

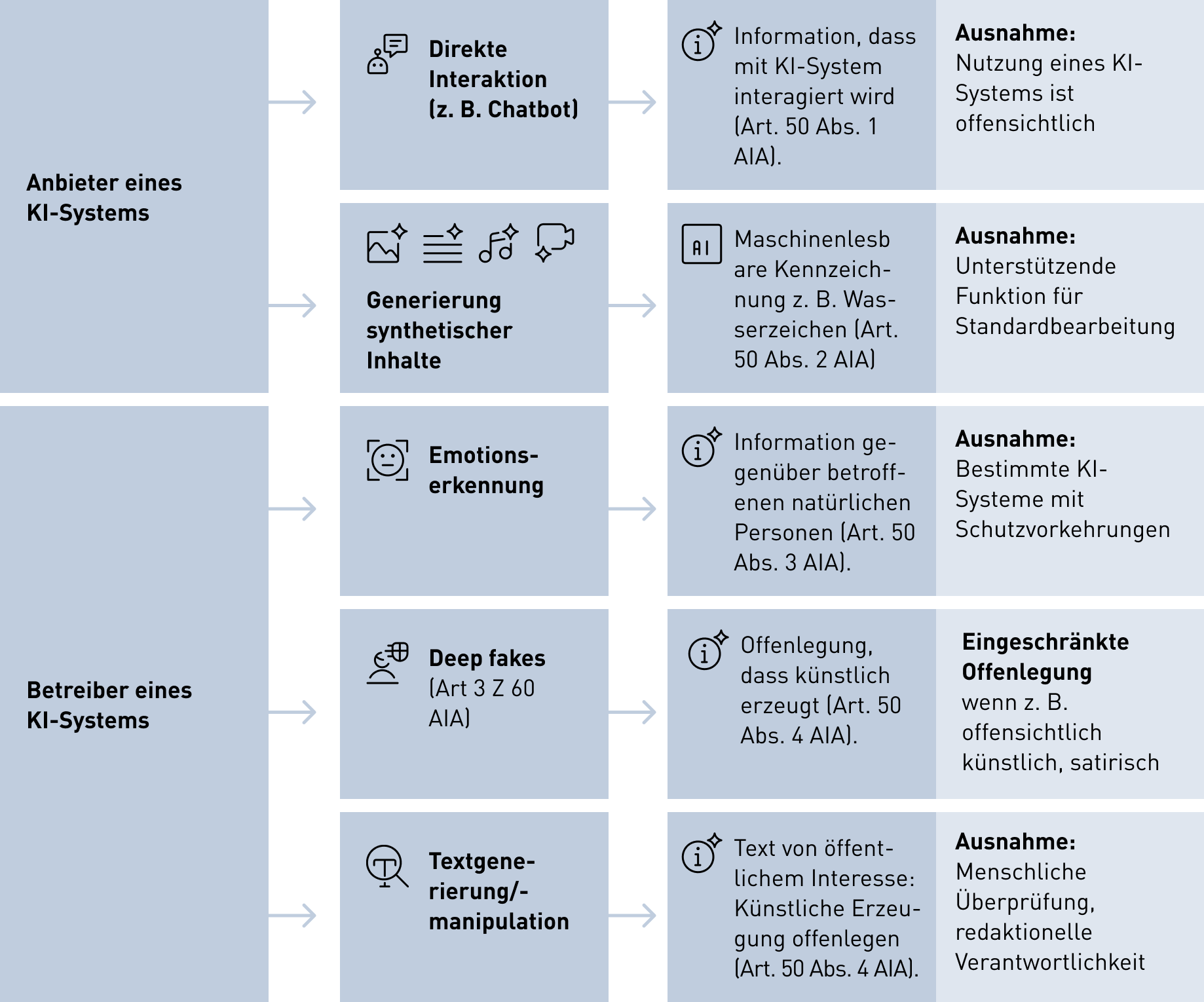

Den Anbietern und Betreibern von KI-Systemen, die der Risikostufe „begrenztes Risiko“ einzustufen sind, legt der AI Act Offenlegungs-, Kennzeichnungs- bzw. Informationspflichten gemäß Art 50 AIA auf (siehe folgende Grafik). Dies betrifft insbesondere auch die Nutzung von generativer KI.

Erzeuger von „Deep Fakes“ – Bild- oder Videoinhalten, die wirklichen Personen, Objekten, Gegenständen, Orten, Einrichtungen und Ereignissen zum Verwechseln ähneln – haben (mit Ausnahmen) offenzulegen, dass die Inhalte künstlich erzeugt oder manipuliert wurden. Für alle anderen Bild-, Ton- und Videoinhalte besteht keine Offenlegungspflicht (Art. 50 Abs. 4 UAbs. 1 AIA).

Bei der Nutzung von generativer KI zur Erzeugung von Text ist die KI-Nutzung offenzulegen, wenn der Text veröffentlicht werden soll, um die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren und keine menschliche Überprüfung oder redaktionelle Verantwortung vorliegt. Ansonsten besteht auch hier keine Transparenzpflicht (Art. 50 Abs. 4 UAbs. 2 AIA).

KI-Kompetenz

Der AI Act sieht vor, dass unabhängig des Risikos der eingesetzten KI-Systeme in Unternehmen die mit der Entwicklung, dem Betrieb und der praktischen Anwendung der KI-Systeme betrauten Personen über ein ausreichendes Maß an KI-Kompetenz verfügen (Art 3 Z 56 AIA iZm Art 4 AIA). Die Bestimmungen zur KI-Kompetenz traten mit 2.2.2025 in Kraft. Die KI-Kompetenz trifft alle relevanten Akteure auf der KI-Wertschöpfungsebene im Kontext ihrer Rolle entlang der Wertschöpfungskette (vgl. ErwG 20). Dabei ist zu beachten, dass je nach Risikoklasse und Einsatzbereich ein unterschiedliches Maß an KI-Kompetenz erforderlich ist. Die technischen Kenntnisse der Mitarbeitenden, ihre Erfahrung, ihre Ausbildung und Schulung und der Kontext, in dem die KI-Systeme eingesetzt werden sollen, sowie die Personen oder Personengruppen, bei denen die KI-Systeme eingesetzt werden sollen, sind zu berücksichtigen. KI-Kompetenz ist ein interdisziplinäres Feld, es umfasst nicht nur technische, sondern auch rechtliche und ethische Aspekte (siehe Erwägungsgrund 20 AIA). So haben sich Anbieter, die sich mit der Entwicklung eines Chatbots beschäftigen naturgemäß mit anderen Thematiken auseinanderzusetzen als ein Betreiber, der dieses System in seinem Unternehmen lediglich anwendet. Diese Präzisierung der unternehmerischen Sorgfaltspflichten soll sicherstellen, dass Mitarbeitende speziell für die für KI neuen Aspekte geschult sind.

Betroffen von der Verpflichtung zu KI-Kompetenz sind damit folgende Personengruppen:

- Mit der Entwicklung von KI betrauten Personen

- Mit dem Betrieb von KI-Systemen betrauten Personen

- Personen innerhalb eines Unternehmens, die KI-Systeme einsetzen.

Über die Art und Weise der zu treffenden Schulungsmaßnahmen bleibt der AI Act offen. Die Kompetenzvermittlung kann intern oder extern, durch e-Learnings oder Fortbildungsveranstaltungen erfolgen. In der Praxis empfiehlt sich, die Arten, Inhalte, Zeitpunkte und geschulten Personen zu dokumentieren. Weiters ist auch ratsam laufende Erhebungen hinsichtlich des Status der vorhandenen KI-Kompetenzen zu tätigen und strategische wie operative Maßnahmen zu setzen.

Detaillierte Informationen zur KI-Kompetenz finden Sie auf der Webseite der KI-Servicestelle

KI-Servicestelle der RTR

Die in der RTR eingerichtete Servicestelle für Künstliche Intelligenz dient als Ansprechpartner und Informationshub einer breiten Öffentlichkeit zum Thema KI. Sie unterstützt auch bei der Umsetzung des europäischen AI Act. Unter ki.rtr.at finden Sie Informationen rund um regulatorische Rahmenbedingungen beim Einsatz von künstlicher Intelligenz sowie den Aspekten im Hinblick auf Cybersecurity, Datenökonomie und deren Einsatz im Medienbereich.

Fragen rund um regulatorische Rahmenbedingungen zum Thema KI können gerne per E-Mail an ki@rtr.at gerichtet werden. Die KI-Servicestelle RTR ist stets bemüht alle Anfragen so rasch als möglich zu beantworten.

Weiter zu: